Was ist ein Context Window?

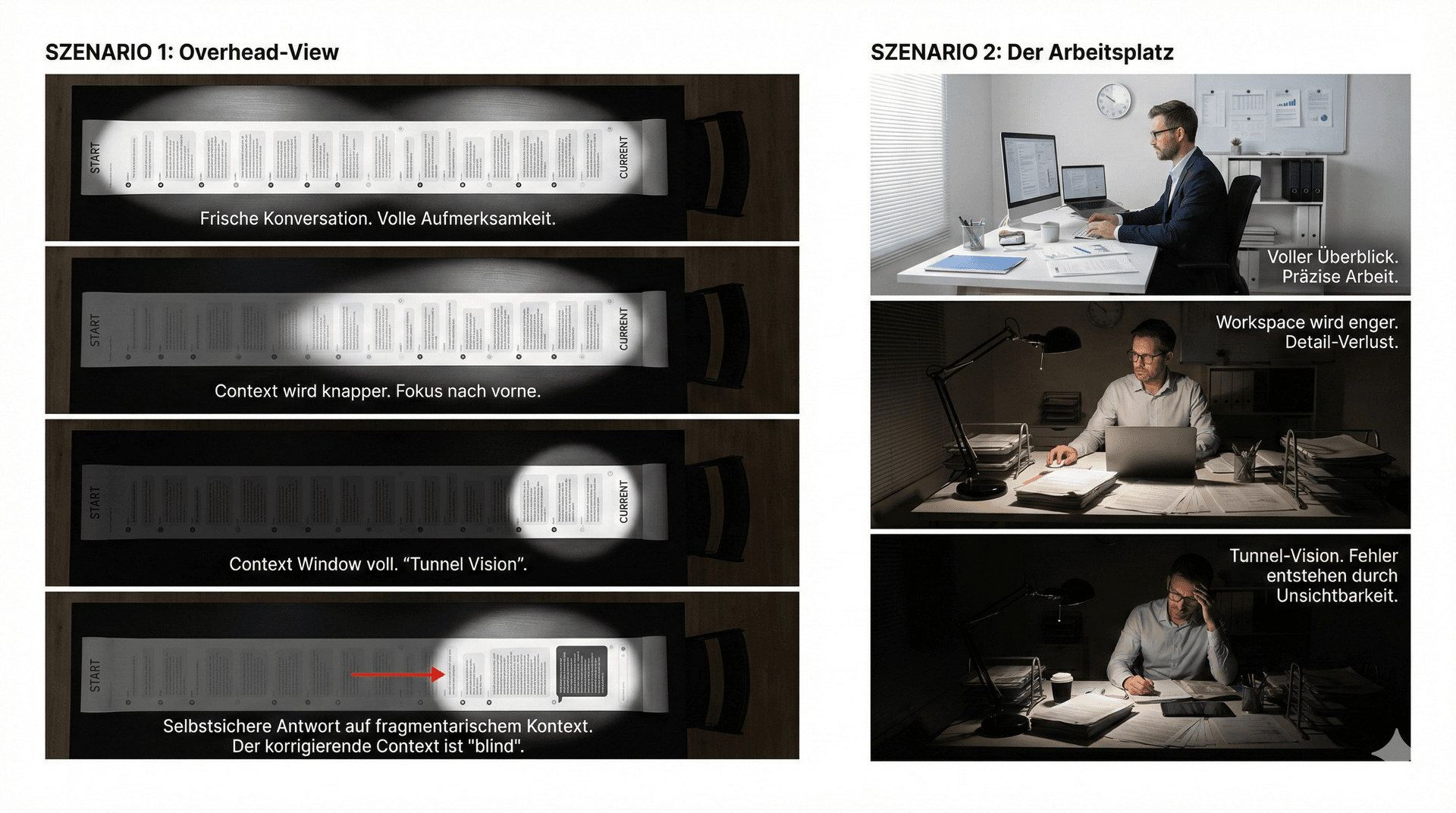

Das Context Window (auch Context Length genannt) ist die maximale Anzahl an Tokens, die ein Large Language Model in einer Anfrage verarbeiten kann. Es ist wie das "Kurzzeitgedächtnis" des Modells - alles, was nicht in dieses Fenster passt, wird nicht berücksichtigt.

Beispiel-Rechnung:

GPT-4: 128K Tokens = ca. 96.000 Wörter = ca. 200 Seiten Text

Claude: 200K Tokens = ca. 150.000 Wörter = ca. 300 Seiten Text

Gemini: 1M Tokens = ca. 750.000 Wörter = ca. 1.500 Seiten Text

Das Context Window umfasst sowohl Ihre Eingabe (Prompt) als auch die Antwort des Modells. Bei längeren Konversationen summieren sich alle Nachrichten auf.